文本摘要研究现状

根据是从原文中抽取还是生成新的段落将文本摘要方法分为抽取式摘要和生成式摘要,抽取式的优点是句子通顺,缺点是缺乏上下文连贯性。目前相关的专家学者已经将目光转向生成式摘要方法,抽取式的工作在2016年达到一个顶峰之后就显有造诣。生成式摘要能够生成更加连贯、准确、丰富的摘要,缺点是需要大量的训练,而目前生成的摘要还做得不够好,特别是生成的摘要效果还无法达到人类的水准。

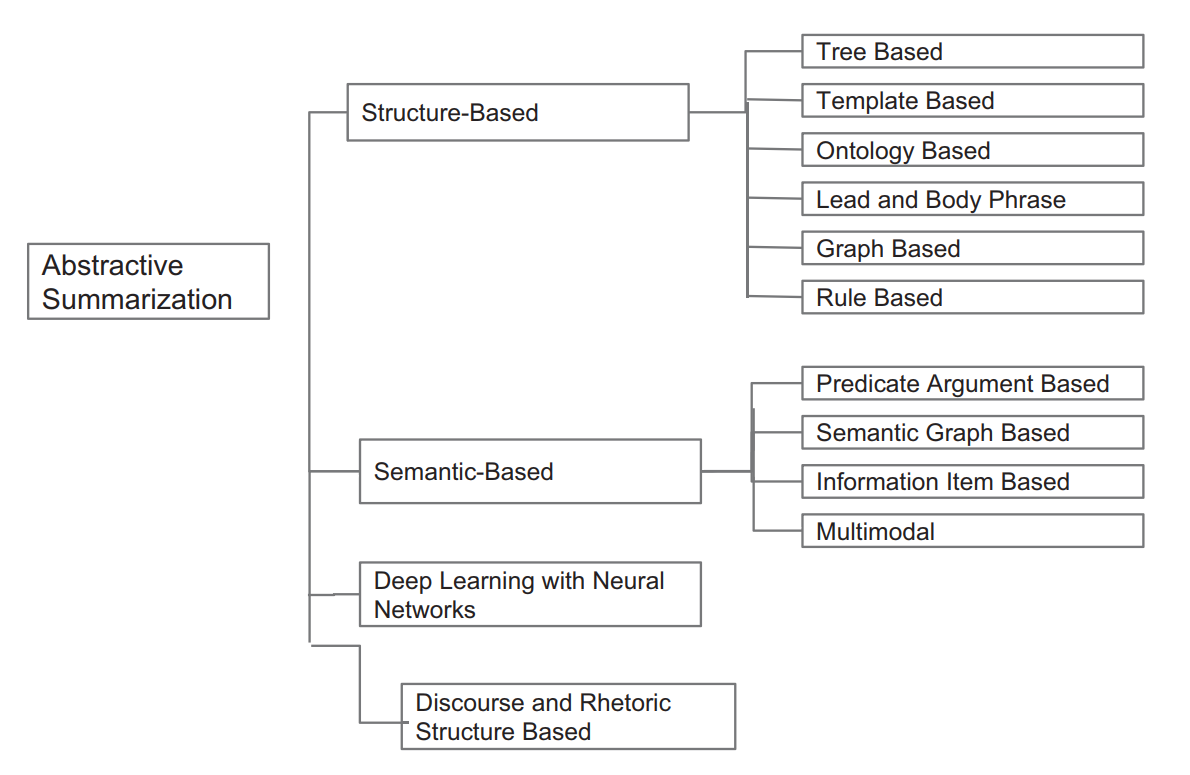

目前生成式摘要研究方法

目前,生成式摘要方法有三种:

- 基于结构的方法:将源文本的关键信息按照预定义的结构构建,然后得到生成式的摘要,如基于树的方法、基于模板的方法、基于实体的方法、基于图的方法、基于规则的方法。

- 基于语义的方法:指直接输入原文本,创建语义段并输入到一个自然语言生成系统中。目前的方法有基于信息词条的、基于预测参数的、基于语义图的方法以及多模态方法。

- 基于深度学习的方法:目前的实现手段通常基于Seq2Seq模型,需要大量的训练数据,是目前的主流方法。

基于深度学习的方法的相关工作

《Neural Attention Model for Abstractive Sentence Summarization》 Rush, A. M., Chopra, S., & Weston, J. (2015).

第一次使用了Attention机制,对原文中每个部分的权重做了规定《Abstractive Text Summarization Using Sequence-to-Sequence RNNs and Beyond》Ramesh Nallapati, Bowen Zhou (2016)

提出层次化编码器,先对每个句子中的词做编码,再对句子编码。《Abstractive Sentence Summarization with Attentive Recurrent Neural Networks》 Sumit Chopra, Alexander M. Rush and Michael Auli.(2016)

和1不同的是作者用到了一个条件RNN。从结果来看,这篇文章较1来说在Gigaword和DUC上的测试结果都要比1好,分别是31.15和24.06的ROUGE-L《Deep Recurrent Generative Decoder for Abstractive Text Summarization》 Liy, P., Lamy, W., Bingz, L., & Wangy, Z. (2017).

作者考虑了文本的结构化信息,在Giga上能达到ROUGE-L 33.5的水准。作者还在中文数据集LCSTS上做了测试,ROUGE-L能达到34.21

《Global Encoding for Abstractive Summarization》 Junyang Lin, Xu Sun, Shuming Ma, Qi Su

北大孙旭教授的团队出品,在传统的模型上使用一个CNN记录全局特征,以供后面生成的时候由上下文依据,也是在LSCTS上有一定的效果提升。ROUGE-L 36.5《Autoencoder as Assistant Supervisor: Improving Text Representation for Chinese Social Media Text Summarization》 Shuming Ma1, Xu Sun1,2, Junyang Lin3, Houfeng Wang1

使用一个自编码网络,加入对抗监督学习以提高encoder阶段输入表征的效果。在LCSTS上取得ROUGE-L 36.2的成绩《A Reinforced Topic-Aware Convolutional Sequence-to-Sequence Model for Abstractive Text Summarization》

腾讯AI lib出品,首次结合ConvSeq2Seq和注意力机制,并捕捉主题信息作偏执,加入强化学习以辅助得到更好的效果,最终达到LCSTS上ROUGE-L 37.92/42.68的成绩(基于字符和基于词)